01Introduzione

L'intelligenza artificiale (AI), in particolare il machine learning (ML), fornisce notevoli funzionalità intelligenti per la micro-nanofabbricazione laser, dimostrando prestazioni eccezionali in aree quali la modellazione dei processi di produzione, l'ottimizzazione dei parametri di processo e il rilevamento di anomalie in-tempo reale. Questo potenziale di trasformazione sta guidando lo sviluppo della prossima generazione di tecnologie di fabbricazione micro-nano laser. Le principali sfide affrontate dalla produzione laser tradizionale derivano dalla complessità delle interazioni laser-materiale, che portano a risultati di lavorazione incontrollabili e all'accumulo di micro-nanodifetti durante processi a più-fasi, con conseguenti infine catastrofici fallimenti dei processi. La combinazione dell'intelligenza artificiale con le tecnologie di produzione laser, attraverso l'integrazione della modellazione-basata sui dati e della modellazione basata sulla fisica-, nonché il monitoraggio in situ intelligente e le tecnologie di controllo adattivo, può affrontare efficacemente queste sfide. Quali cambiamenti rivoluzionari avverranno quando l’intelligenza artificiale “incontrerà” la produzione laser?

02Machine Learning-Intelligenza assistita

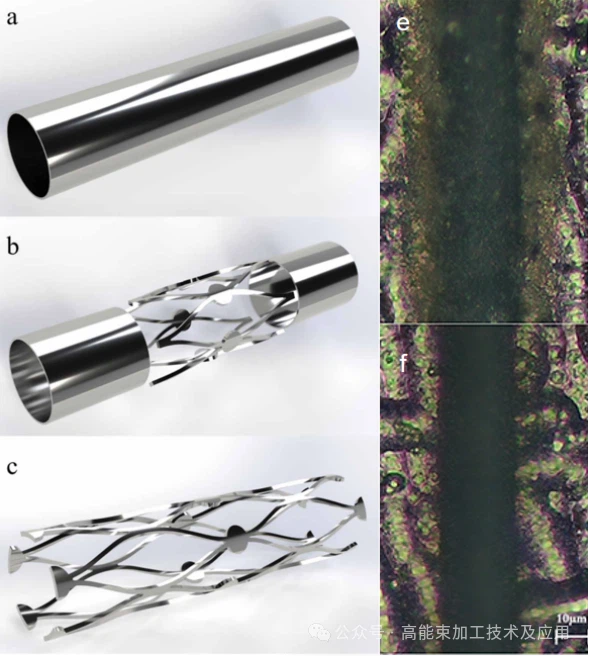

Lavorazione laser Nella lavorazione laser convenzionale, i processi fisici delle interazioni laser-materiali comportano complessi effetti termodinamici non lineari, comportamenti fluidodinamici e transizioni di fase, rendendo i meccanismi intrinseci altamente complicati e influenzati da numerosi parametri di processo come la potenza del laser e la velocità di scansione. Sebbene i modelli analitici-basati sulla fisica o le simulazioni numeriche abbiano un chiaro significato, devono affrontare sfide significative nella caratterizzazione accurata di fenomeni transitori, multi-scala e multi-fisici durante l'elaborazione pratica. Il vantaggio principale della modellazione assistita dal machine learning- risiede nella sua capacità di apprendere complesse relazioni non lineari dai dati, acquisendo in modo efficace le correlazioni di mappatura tra parametri di processo, stati di processo e indicatori di qualità finale, "aggirando" in tal modo l'analisi complessa del modello fisico per ottenere previsione, ottimizzazione e controllo dei risultati dell'elaborazione. La modellazione con elaborazione laser assistita dal machine learning-si divide principalmente in due tipi: modellazione-guidata dai dati e modellazione-guidata dalla fisica. Rispetto alla modellazione basata sui dati, che esplora "modelli a scatola nera" tra input e output attraverso dati sperimentali, la modellazione basata sulla fisica incorpora le leggi fisiche come vincoli morbidi (termini di funzione di perdita) o vincoli rigidi (architettura di rete). La modellazione-guidata dalla fisica non solo utilizza dati osservativi, ma integra anche completamente le conoscenze pregresse che descrivono i processi fisici fondamentali. Modellazione-guidata dai dati: le interfacce-Brain Computer (BCI) stabiliscono percorsi di comunicazione tra il cervello umano e i dispositivi esterni bypassando i percorsi di neurotrasmissione biologica attraverso sistemi di acquisizione e decodifica dei segnali neurali. Attualmente, una tecnica di intervento neurale relativamente avanzata impiega sistemi di elettrodi minimamente invasivi distribuiti all’interno del sistema vascolare cerebrale. Gli stent in nitinol fungono da portaelettrodi intravascolari per raccogliere segnali elettroencefalografici o fornire stimolazione elettrica. I metodi di assemblaggio tradizionali utilizzano principalmente adesivi polimerizzabili ai raggi ultravioletti-per fissare gli elettrodi di platino alla superficie dello stent combinati con connessioni di micro-saldatura. Il meccanismo di "elaborazione a freddo" dei laser ultraveloci mantiene l'integrità dell'interfaccia neurovascolare senza causare danni termici. Utilizzando XGBoost (eXtreme Gradient Boosting) e SVM (Support Vector Machine), è possibile effettuare previsioni sulla larghezza dell'incisione e sulla frequenza di ripetizione. La verifica sperimentale ha mostrato che l'energia del singolo-impulso è stata ridotta da 20 μJ non ottimizzati a 7,64 μJ, la frequenza di ripetizione è aumentata da 40 kHz a 52,28 kHz e la velocità di scansione è diminuita da 20 mm/s a 8,33 mm/s. I risultati dell'elaborazione sono mostrati nella Figura 1. La Figura 1e mostra la morfologia della microstruttura non ottimizzata, mentre la Figura 1f mostra la morfologia dell'elaborazione ottimizzata, indicando chiaramente che la struttura ottimizzata ha una zona influenzata dal calore più piccola-e una maggiore precisione di elaborazione.

Modellazione dei meccanismi fisici:

Rispetto al costo elevato e al lungo ciclo della modellazione basata sui dati-, la modellazione dei meccanismi fisici supera la necessità di set di dati pre-calcolati incorporando equazioni differenziali parziali nella funzione di perdita di una rete neurale. La microlavorazione-al plasma indotto dal laser (LIPMM) è limitata da spiegazioni teoriche fisiche incomplete e da notevoli costi di tempo. Nonostante siano stati fatti tentativi per utilizzare l’apprendimento automatico per la lavorazione laser dei materiali, la mancanza di dati sufficienti rimane un grosso ostacolo. Nei framework di machine learning guidato da-modelli-fisici, i parametri dei meccanismi intermedi generati dai modelli fisici, come la densità di picco del plasma e la durata del plasma, vengono aggiunti come dimensioni extra ai vettori del set di dati originali, combinati con algoritmi genetici per ottimizzare i parametri di processo multi-dimensionali. L'inclusione di informazioni sui meccanismi fisici aumenta le dimensioni dei dati, arricchisce il set di dati di addestramento e riduce la quantità di dati richiesti. Questo approccio migliora l'accuratezza del modello con campioni di piccole dimensioni, consentendo così una previsione accurata della profondità LIPMM. L'introduzione di informazioni fisiche guida il processo di ottimizzazione con implicazioni fisiche più ragionevoli, vale a dire una densità di picco del plasma più elevata, una durata del plasma più lunga, una maggiore energia del singolo impulso- e una sovrapposizione di spot relativamente più piccola, ottimizzando così le prestazioni del LIPMM.

03 Riepilogo

L'integrazione dell'intelligenza artificiale e dell'elaborazione laser micro-nano sta attraversando una profonda rivoluzione, con il suo ruolo che si evolve dall'ottimizzazione del processo a-punto singolo alla costruzione di sistemi di "produzione cognitiva" end-to{3}}end. Attualmente, l'avanguardia in questo campo è incentrata su modelli fisicamente-informati, in particolare sull'applicazione approfondita delle reti neurali-informate sulla fisica. Questo paradigma avanzato di machine learning non è più semplicemente un-"imitatore" basato sui dati, ma un "comprensore" delle leggi fisiche. Incorporando equazioni fisiche fondamentali come la conduzione del calore e la dinamica dei fluidi come vincoli nel processo di addestramento delle reti neurali, i modelli possono ancora fare previsioni accurate in conformità con i principi fisici nonostante i dati sperimentali scarsi. Ciò non solo risolve la dipendenza dei modelli tradizionali di apprendimento automatico da enormi set di dati etichettati, ma conferisce anche una capacità di generalizzazione di “inferenza da uno a molti”, rendendo le loro previsioni fisicamente interpretabili. Attualmente i ricercatori stanno costruendo ambienti di formazione “ibridi”. In questo ambiente, l'impostazione dell'apprendimento per rinforzo si basa su simulazioni fisiche altamente realistiche per apprendere strategie di elaborazione fondamentali, che vengono poi rapidamente perfezionate-e convalidate utilizzando dati reali durante l'elaborazione.

L'apprendimento automatico trasforma le complesse interazioni tra luce e materia in leggi fisiche programmabili e ottimizzabili, spingendo l'industria manifatturiera a realizzare un cambiamento di paradigma dalla "dipendenza- dall'esperienza" all'"autonomia cognitiva". Questa profonda integrazione ci sta portando oltre i tradizionali approcci per tentativi ed errori verso una nuova era di produzione precisa guidata sia dai dati che dalla conoscenza fisica.